ビッグデータの利活用が進む一方で、プライバシー保護の問題が社会の一大関心事となっている。データ解析において、データの安全性確保と解析精度の担保は、相反する課題だ。ユーザーのプライバシーを守りつつ、有用性の高い解析結果を得るためにはどうすればいいのか。「差分プライバシー」という安全性指標を満足させつつ、高精度な解析結果を実現する画期的な新プロトコルを開発した3人の研究者に話を聞いた。

プライバシーを保護しながらデータ解析精度を高める新手法

パソコンやスマートフォンはもちろん、家電製品や自動車などさまざまなものがインターネットにつながっている現代社会。世界中で膨大な数のデバイスから日々刻々と収集されるビッグデータを解析することによって、多くのサービスが提供されるとともに、社会の課題解決に活用されている。

一方で気になるのが、個人情報漏洩などプライバシーの問題だ。例えば、スマートフォンの位置情報を集めたビッグデータを解析することで得られる統計情報のうち、「時間帯ごとの人口分布」から、特定の個人の位置情報があぶり出される恐れがある。また、深層学習モデルから、学習データとして利用された個人情報が推定されるといったケースも考えられる。

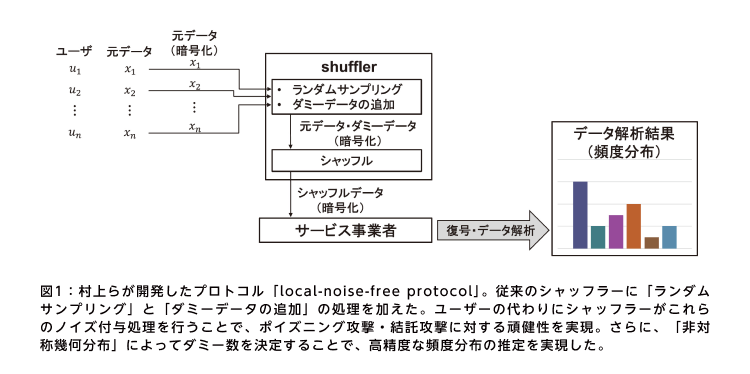

プライバシーがきちんと守られた状態での利活用を望む声が高まるなか、統計数理研究所の村上隆夫准教授と電気通信大学の清雄一教授、産業技術総合研究所の江利口礼央研究員の3人が共同研究によって開発したのが、「非対称幾何分布」という新たな分布を導入したプロトコル「ローカルノイズフリー・プロトコル(local-noise-free protocol)」だ(図1)。

村上は「データ解析において、データの安全性と有用性はバーターで、安全性を高めればデータの精度は低くなり、解析の精度も下がってしまう。今回のプロトコルは、安全性とデータ精度を両立できることが最大の特長です」と説明する。

安全性指標「差分プライバシー」で攻撃と防御のいたちごっこに終止符

村上らが開発した新プロトコルによるプライバシー保護技術は、現在のデファクトスタンダードとなっている「差分プライバシー」という安全性指標を満たすものだ。

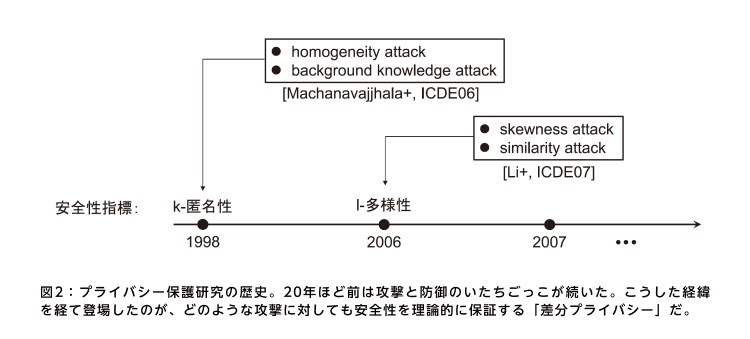

悪意をもって仕掛けられた攻撃に対し、その解析手法は脆弱なのか、安全なのか。それを図るための安全性指標の研究は、1990年代の終わり頃に始まっている。しかし、新しい指標が構築されては破られる、いわば“いたちごっこ”が長い間続いていた(図2)。

そんなプライバシーの安全性に対する懸念が現実味を帯びた形で提示されたのは、2010年代の終わり頃のことだった。アメリカ合衆国国勢調査局が、2010年の米国国勢調査の集計表をいくつか突き合わせると、個人が特定されてしまうリスクがあることを明かし、警鐘を鳴らしたのだ。

「これを機に、どのような攻撃に対しても安全性を理論的に保証する指標を求める声がますます高まりました。そのような指標として注目されているのが『差分プライバシー』の理論です」。村上はそう説明する。端的に言えば、データを加工するメカニズムが差分プライバシーを満たしていれば、どのような攻撃がなされても安全、というわけだ。2020年には、アメリカでも国勢調査に差分プライバシーが導入された。

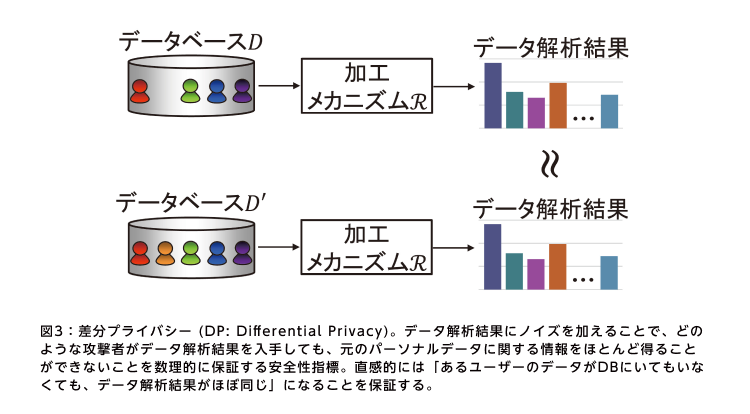

差分プライバシーを満たすには、データ解析結果にノイズを加えればよい。ある人のデータを含まないデータベース「D」と、その人のデータを含むデータベース「D’」があり、加工メカニズムRでノイズを加えるとする。DとD’どちらのデータベースを解析しても、結果がほぼ同じになる場合に、「加工メカニズムRは差分プライバシーを満たす」という(図3)。

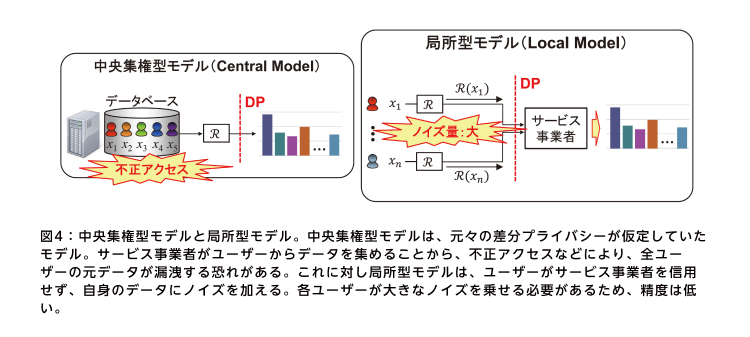

差分プライバシーを実現するモデルとしては、すでに「中央集権型モデル」と「局所型モデル」が開発され、普及していた(図4)。中央集権型モデルは、サービス事業者がユーザーからデータを集め、データ解析結果にランダムなノイズを加えたうえで第三者に提供したり、公開したりするもの。だが、このモデルでは不正アクセスなどにより、全ユーザーのデータが漏洩する恐れがある。

これに対し局所型モデルは、ユーザー自身がデータにノイズを加えるもので、出力データは差分プライバシーを満たし、元データに関する情報はほとんど漏洩しない。しかし、各ユーザーがデータに大きなノイズを乗せる必要があるため、解析精度は低くなってしまう。

そこで研究者たちは、中央集権型モデルの精度のよさと局所型モデルの情報漏洩リスクの少なさを足し合わせたような理想的なモデルを追究した。近年になり、ユーザーとサービス事業者の間に「シャッフラー」と呼ぶ中間サーバを挟み、受け取ったデータをランダムにシャッフルすることで、個人を識別できないようにする「シャッフルモデル」が提案された。

従来のシャッフルモデルの課題を根本的に解決した新プロトコル

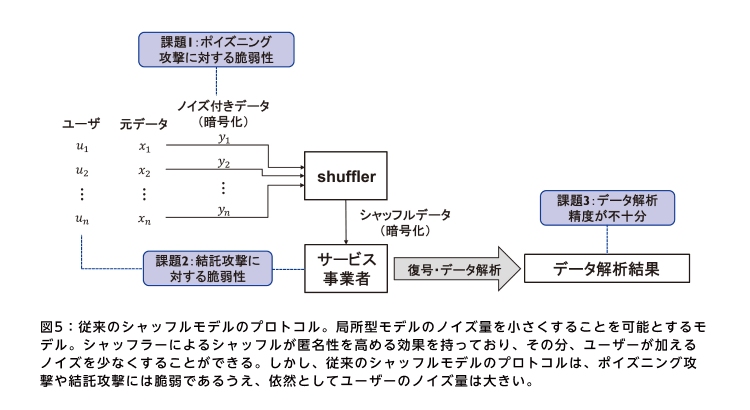

中央集権型モデルと局所型モデルの長所を併せ持つシャッフルモデル。しかし、これにもまだ課題があった(図5)。

一つは、一部の悪意を持ったユーザーが、自身のデータと異なる偽データを送ることで、データ解析の精度を下げる「ポイズニング攻撃」に対して脆弱であること。また、サービス事業者が一部のユーザーと結託する「結託攻撃」に対しても脆弱であること。さらには、局所型モデルよりはユーザーが加えるノイズを少なくできるものの、依然としてそのノイズ量が大きいという問題もあった。

今回のプロジェクトが提案する前述の「ローカルノイズフリー・プロトコル」は、従来のシャッフルモデルの持つこれら三つの課題を解決したものだ。

このプロトコルでは、ユーザーは自身のデータに一切ノイズを加えず、そのまま暗号化してシャッフラーに送る。その後、シャッフラーは、次の処理を行う。(1)ユーザーから受け取ったデータを一定の確率で削除する「ランダムサンプリング」、(2)データの取り得る値のそれぞれに対し「ダミー数分布」と呼ばれる分布に従ってダミーデータ数を決定し、その数だけ暗号化されたダミーデータを追加する「ダミーデータの追加」、(3)残ったユーザーのデータとダミーデータをランダムにシャッフルする「シャッフル」だ。

「シャッフラーがユーザーの代わりに、ランダムサンプリングとダミーデータの追加というノイズ付与処理を行うことで、ポイズニング攻撃と結託攻撃に対する頑健性を実現しました。さらに、ダミー数分布として『非対称幾何分布』という新しい分布を導入することで、従来のシャッフルモデルのプロトコルより遥かに高精度な頻度分布の推定を可能にしています」と村上は自信を覗かせる。

トップ会議のリジェクトをバネに前例のないダミー数分布を導入

今回のプロジェクトは、数年前から差分プライバシーに関する共同研究を進めてきた村上と清教授が、新たなテーマを探すなかで出合った論文をきっかけとする。内容は、中央集権型モデルにおける「k-匿名性」という安全性指標と、データのランダムサンプリングを組み合わせることで差分プライバシーを実現する、というもの。

「このk-匿名性の処理の代わりにダミーデータの追加を行うことで、同様に差分プライバシーを実現するプロトコルをシャッフルモデルで作れることに気づき、今回の『ローカルノイズフリー・プロトコル』の原型の着想に至りました」(村上)。そこで、関連する暗号理論や安全性解析の専門家である江利口研究員にも声を掛け、3人で共同研究をスタートしたという。

応用性や実践性を重視する情報セキュリティ関連技術を対象とする国際的なトップクラスの会議としては、IEEE S&P (IEEE Security and Privacy) やACM CCS (ACM Conference on Computer and Communications Security)、USENIX (USENIX Security Symposium)、NDSS (The Network and Distributed System Security Symposium) などが知られている。

今回の研究成果は、2024年6月に上記のIEEE S&Pに投稿し、10月に採択された。同11月には統計数理研究所、電気通信大学、産業技術総合研究所の3者が合同でプレスリリースを発信。2025年5月にはサンフランシスコで開催されるIEEE S&Pでの発表も控えている。

「この分野で勝負するなら、これらの会議に論文を通すことが何よりも重要な状況です。10年くらい前から、とにかく質の高い研究を行って、トップ会議を目指したいと思ってきました」と村上は振り返る。

順風満帆に見えるプロジェクトだが、じつは当初、ACM CCSに投稿した論文がリジェクトされ、悔しい思いも味わったという。査読で受けたのは、「プロトコルの新規性が弱い」「比較していない既存手法がある」との指摘だった。

これに対し3人は、ダミー数を決定するために、まだ誰も採用していなかった「非対称幾何分布」をプロトコルに導入。既存の七つの手法と比較して、提案手法のほうが解析精度、攻撃への頑健性ともに劇的に優れていることを証明してみせたのだ。

アイデアとテクニックを惜しみなく出し合うチームの連携プレー

「今回の共同研究は、お互いにアイデアを出し合いながら、質の高い研究を行うために非常によい連携ができています。引き続き、内容をブラッシュアップしていきたい」と村上は抱負を語る。

清教授も「村上先生、江利口研究員の卓越した知識と技術力は、研究をより高度なレベルへと引き上げる重要な要素になっており、大変心強く思っています。今後もこの連携を武器に、さらなる研究成果の創出に向けて尽力したい」と話す。

また、江利口研究員は「トップ会議に採択されるには、単に安全性や精度を量的に向上するだけでなく、そのためのテクニックの新規性が求められます。今回、その部分に貢献できたことを嬉しく思います」と話す。

AI(人工知能)の急速な発展とデータ駆動型社会の進展に伴い、プライバシー保護の重要性はかつてないほど高まっている。3人が目指しているのは、データの有用性を損なうことなくプライバシーを守るための新たなアプローチを探求し、安全かつ柔軟にデータとAIを活用できる社会の実現だ。

「差分プライバシー技術は、アルゴリズムが他の暗号技術と比べて軽量であることが多く、社会実装と相性がよい」(江利口研究員)という。ただし、現実の世界で要求されるレベルの安全性や精度を達成するには、多くの課題も残る。今回の成果を足がかりとして、このチームでの研究がさらなる進展を遂げ、ユーザーが安心してデータを提供し、サービス事業者が安全にデータを活用できる社会が訪れることを期待したい。

(広報室)