深層ニューラルネットによるAI技術の開発は、欧米の巨大IT企業の寡占状態にあると言われる。その原因となっているのが、ビッグデータを取り込み膨大な計算をするためのコンピュータ設備と、それを扱う人材にかかる「コスト」だ。統計数理研究所を中心とするチームは、既存の深層ニューラルネットとは異なる深層構造モデルを開発することで計算コストを下げ、中小企業など、巨大IT企業でなくともAI技術を活用できる環境を整えるための研究を進めている。

AIが“新しい電気”となるのを阻むコストの障壁

「AI(人工知能)を電気のように社会の隅々まで行き渡らせるには、まずコストの問題を解決する必要があります」。統計数理研究所統計的機械学習研究センターのセンター長を務める福水健次教授はそう話す。

“電気のように”という比喩は、深層学習の研究者Andrew Ng氏による「AIは新しい電気だ」という言葉を受けたもの。電力供給が始まった当初は、扱える人が少なく給電方法も特殊だったが、やがて都市や産業の設計もその利用が前提となっていった。AIも似たような経過をたどり、電気と同じように一般家庭にも行き渡り、なくてはならない社会インフラになる、と予言したのだ。

しかし、現状はまだそうはなっていない。その障壁となっているものの一つが、研究や技術開発にかかるコストだと福水は言う。

“第三の波”と言われる今のAIブームの核は、ニューラルネットワークによる深層学習(ディープラーニング)だ。「ニューラルネット」は人間の脳の仕組みを模した情報処理システムで、外部からの信号を集めて処理し出力する「パーセプトロン」と呼ぶ計算単位からなる。深層ニューラルネットは、このパーセプトロンを何十層、何百層と重ねて計算を行い、答えを出力する仕組みだ。

深層ニューラルネットが注目されたきっかけは2012年、ある画像識別タスクのコンペティションで、8層の深層学習によるモデルが際立った成果を叩き出したことだった。それ以降、より多層な構造のネットワークが登場し、2015年には152層のモデルの誤識別率は3.57%にまで下がっている。また2016年に、AIによる囲碁ソフト「Alpha Go」が最強レベルのプロ棋士を破ったことで、深層学習の可能性が世界に知れ渡った。

インターネットによってビッグデータを容易に取得できるようになったこと、コンピュータの計算能力と性能が飛躍的に向上したことなども、深層学習の隆盛を後押しした。画像認識や画像の生成・変換、自動翻訳などの技術はさらなる進化を続けており、さまざまな分野での技術革新が始まっている。

ところが、現状でAIを存分に研究し、技術開発を進めているのは、自社の提供する検索エンジンやSNSのビッグデータを取得可能で、高性能コンピュータを保有し、優秀な研究者を抱える巨大IT企業に限られている。アカデミアは企業の持っているデータを使うことができず、中小企業は計算資源も人的資源も足りず、深層学習を技術革新に活用できていないのが実情だ。「低コストで学習でき、信頼性も十分で、現行のモデルと同等以上の高性能なモデルを開発できれば、巨大IT企業だけでなく誰もがAI技術を扱えるようになるでしょう」と福水は説明する。

機械と人間のあいだをつなぐ数学の言葉

福水は以前から共同研究などで親交のあった東京大学大学院情報理工学系研究科の鈴木大慈准教授と、実世界知能の実現技術に詳しい東京大学先端科学技術研究センターの原田達也教授にも声をかけ、「数理知能表現による深層構造学習モデルの革新」のテーマで2020年度の戦略的創造研究推進事業「CREST」に応募し、採択された。チームには、統数研の日野英逸教授と持橋大地准教授、本武陽一特任助教、今泉允聡客員准教授(東京大学)も参加している。

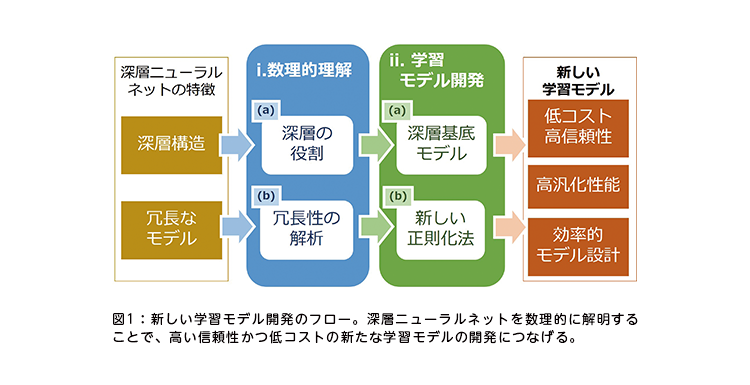

このプロジェクトのポイントは、数理的知能表現を活用することで、現行の深層学習に使われている「深層ニューラルネット」とは異なる深層構造を持つモデルを生み出そうとする点だ(図1)。「数理知能表現」とは知能や知識を表現するための数理的方法のことで、特にこのプロジェクトでは関数空間、代数構造、微分方程式などによるアプローチを研究している。「数理的アプローチによって、AIを誰もが使いやすい技術にしたいと考えています」と福水は力を込める。AIを本当の意味で社会インフラにする、大きな挑戦だ。

目的を達成するための研究課題は「深層構造の理論的理解による効率的で信頼性の高い数理知能表現モデルの研究」「深層構造モデルの最適化アルゴリズムの研究」「実世界問題への実践的応用による方法と理論の深化」の三つ。福水をリーダーとする統数研メンバーによる数理深層モデリングG、鈴木准教授をリーダーとする数理表現・最適化G、原田教授をリーダーとする実践的学習Gがそれぞれの課題を担当する。

このプロジェクトにおける福水のグループの課題の一つは「数理構造による深層モデリング」の研究だ。例えば、既存の深層ニューラルネットによる画像生成技術では、「サングラスをかけた男性」の学習データから「男性」のデータを引き算し、さらに「女性」のデータを足し算して、元のデータにはなかった「サングラスをかけた女性」の画像が生成される、といった興味深い現象が知られている。だが、その理論はブラックボックスになっている。代数的なアプローチによって、その数理構造を解明することが研究課題の一つだ。

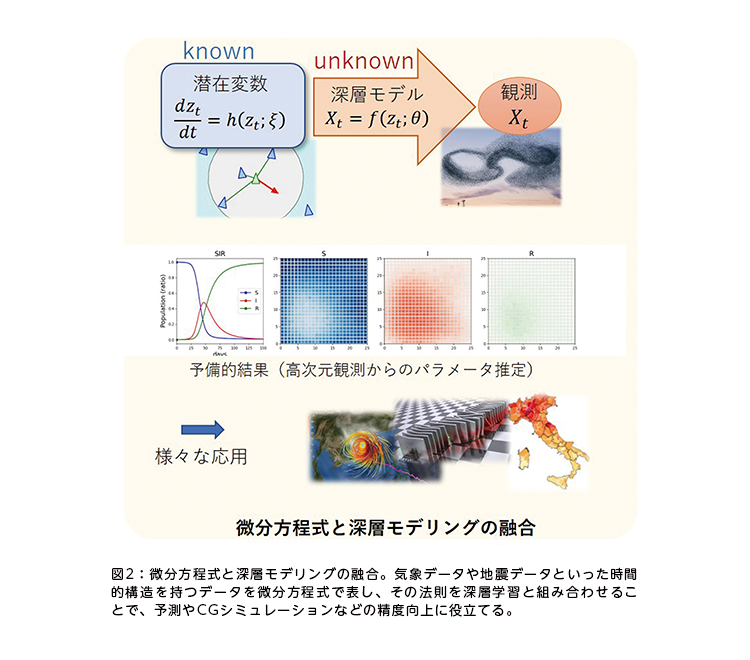

二つ目の課題は、「微分方程式と深層モデリングの融合」。自然現象や機械の動作の記述などのように時間的な構造を持っているデータは、数学では微分方程式で表されることが多い。その時間的な「法則」を深層学習と組み合わせて、予測やCGシミュレーションなどの精度を向上させる技術を開発することが目標だ(図2)。「例えば気象データや地震データなども時間的構造を持つデータですから、災害予測や防災にも役立つことが期待できます」(福水)。

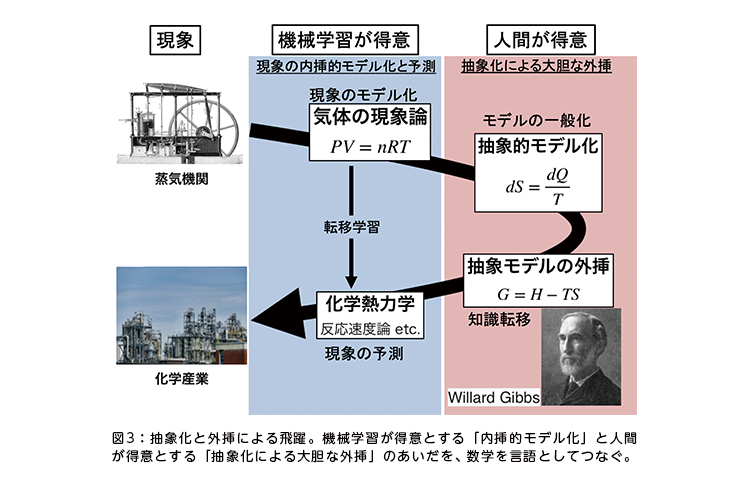

この課題については、福水研究室のメンバーでもある本武が中心となって取り組んでいる。本武は物理学の専門家で、物理現象の解明に深層学習を援用する研究をしていた。「機械学習は複雑な物理現象を内挿的に(学習データの数値の範囲内で)モデル化するのは得意ですが、外挿的、つまりリンゴが木から落ちるのを見て万有引力の法則を思いつくというニュートンの物語にあるような大胆なアイデアでは人間に及びません。両者のよい面を融合するためにはあいだをつなぐコミュニケーションが必要で、数学的モデル化がその言語の一つとなるのではないかと期待しています」と本武は話す。具体的には、時間的構造を持つデータから深層ニューラルネットで保存則などの法則をモデル化したり、逆に人間が持っている知見を深層ニューラルネットに導入したりといったことを考えている(図3)。

億単位のパラメータでも過学習を起こさないことを数学的に証明

鈴木准教授のグループが研究しているのは、より数学的な「数理表現・最適化」だ。深層学習の研究は今、世界中で活発に行われているものの、非常に複雑で数理的な扱いが難しく、分からないことがたくさんある。未知な部分を数理的に解明することで本質を捉え、より低コストな学習を実現するのがこのグループの狙いだ。

このグループのメンバーである今泉准教授は「深層学習では層が増えるほど、またパラメータが多いほど高い精度を発揮することが実験で確かめられていますが、これらは今までの数学の常識とは矛盾しており、なぜそうなるのか分かっていません。私たちにとってはこれが解き甲斐のある魅力的な“謎”なのです」と微笑む。

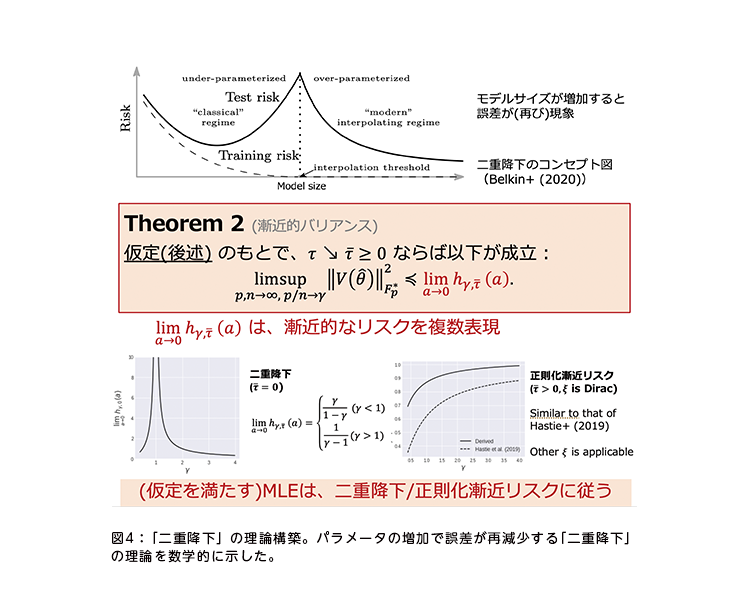

過剰なパラメータの謎について理論研究者の間では最近、「二重降下」説が注目されているという。パラメータが増えると一旦は誤差が大きくなるものの、再び降下し始めるのではないかというのだ。今泉准教授は、深層学習においても特定の条件を与えれば、パラメータを億単位まで増やしても過学習に陥ることなく、誤差が小さくなることを初めて理論的に示した(図4)。

一方、原田教授のグループは「実践的応用」の研究を担っている。動画と音声、画像とテキストなどマルチモーダルなデータの認識や生成といった、社会とのインターフェースとなる重要な部分だ。「原田教授の既存研究には興味深いものが多く、今回のプロジェクトでも理論と応用を結ぶ成果を期待しています」(福水)。

例えば、人が自転車に乗っている動画を正しく判定することは現状のAIにもできるが、原田教授の開発した技術ではその動画に「スケートボードではなく自転車に乗っている。なぜならば座った姿勢をとっているからだ」と、理由までテキストで提示することができる。また現状のAI技術では、実写の動画に映っている馬をシマウマに変換することはできても、ゼロから馬のデータを生成して動かすことは難しい。プロジェクトでは、それを可能にするような研究も行うという。

「画像や動画と音声や言語などを融合的に情報処理していく技術は、今後非常に重要になってくるはず。効率のよい深層構造モデルを使って複雑なタスクを解いていけるようにしたい」と福水は話す。

さらに、医療画像への応用も期待される。CTやMRIなどの検査画像は、超高解像度で3次元、時間を加えた4次元のものもあり、データ容量は莫大になる。プロジェクトが目標としている「よりコストのかからない深層学習モデル」ができれば、医療画像の解析には特にメリットが大きいだろう。

日本の中小企業が巨大IT企業を追い抜く日

福水は、CRESTのプロジェクトの延長上に、さらなる展望を描いている。まず機械学習の面では、前述の「微分方程式と深層モデリングの融合」をさらに進化させ、自然現象など時間的に移り変わる事象の「法則」を自動的に抽出する技術に結びつけること。

また数理科学の面では、深層構造のための「関数空間の理論」を確立すること。関数空間の理論は数学界では古くから研究がなされてきた成熟分野だが、深層学習は工学や統計学の分野から生まれたため、その研究にぴったりの理論があるわけではない。深層学習を解析するために必要な数学理論を開発していくことが欠かせない。

さらに、この研究を進めることには、大きな社会的意義もある。巨大IT企業でなくとも容易に適用できるAI技術を創出することによって、冒頭で述べたように、AIが電気と同じように社会に普及する世界を創出することも夢ではなくなるのだ。

「欧米に比べて周回遅れとも言われる日本企業のAI研究が、一気に挽回して前線に躍り出るチャンスもあると考えています。巨大なコンピュータでなければ出せない性能をパソコンや機械に内蔵するチップに組み込めるようになれば、状況は大きく変わるでしょう」と福水は期待を込める。

AIを電気のような社会インフラにする――。そのためのイノベーションの第一歩が今、踏み出された。

(広報室)

新型コロナウイルス感染拡大防止のため、本インタビューはオンラインで行われました。